LLMの文脈理解と維持:「Model Context Protocol」の概念と長期記憶への挑戦

人間同士の会話では、以前話した内容を覚えているからこそ、スムーズなコミュニケーションが成り立ちますよね。LLMにとっても、この「文脈(コンテキスト)をどれだけ長く、正確に保持できるか」は非常に重要です。特に、長い文書の要約、複雑なタスクの実行、長時間の対話などでは、初期の指示や途中の情報が失われると、性能が著しく低下してしまいます。

コンテキスト長の限界と課題:

- コンテキストウィンドウ: LLMが一度に処理できる情報の量(トークン数)には上限があり、これを「コンテキストウィンドウ」と呼びます。近年のモデルでは数十万トークンを超える長いコンテキストウィンドウを持つものも登場していますが(例: GoogleのGemini 1.5 Pro)、それでも無限ではありません。

- Lost in the Middle: コンテキストウィンドウが長くても、入力情報の中間部分にある情報を見落としやすい、という研究結果も出ています。

- 計算コスト: コンテキストウィンドウが長くなるほど、計算に必要なメモリや時間が増大します。

解決へのアプローチ:

- コンテキストウィンドウの拡張: モデル自体のアーキテクチャを改良し、より長いコンテキストを扱えるようにする研究開発が進んでいます。

- コンテキスト圧縮: 長い文脈情報を、重要な情報を保持したまま短い形に要約・圧縮する技術。

- 外部メモリ/データベース連携: RAGのように、必要な情報を外部のデータベースなどに保存しておき、対話の途中で適宜参照する仕組み。これは、事実上、コンテキストウィンドウの限界を超える方法と言えます。

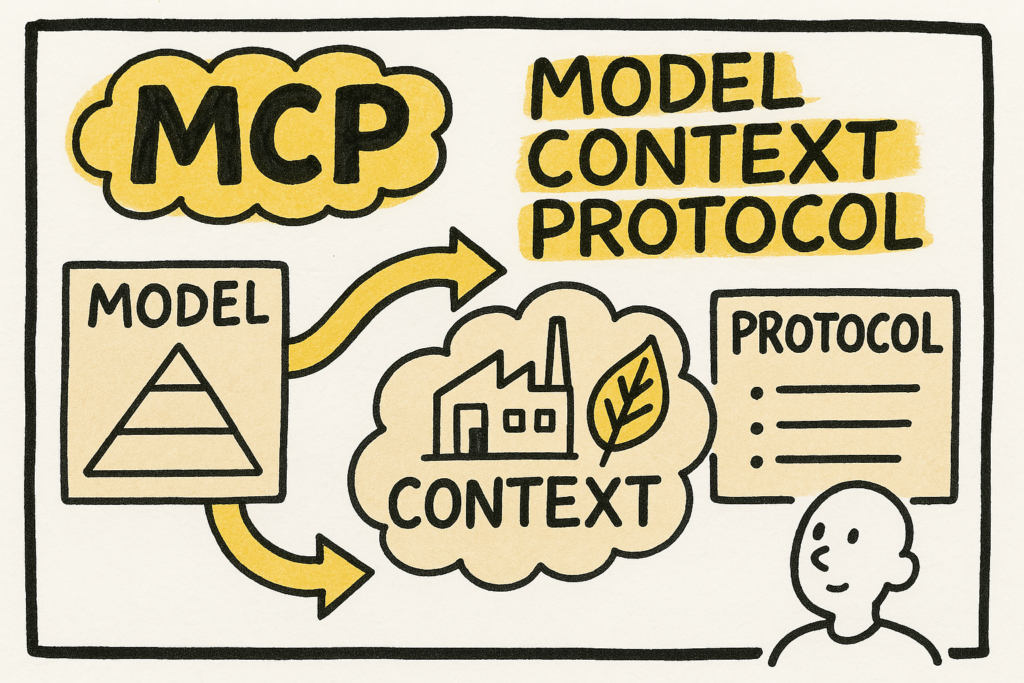

Model Context Protocol (MCP) の概念: 「Model Context Protocol」という言葉は、まだ広く標準化された技術規格を指すわけではないかもしれませんが、LLMが対話やタスクの文脈情報をどのように効率的かつ効果的に管理・維持・参照するか、そのための仕組みやルール(プロトコル)の重要性を示す概念として議論され始めています。 これは、単にコンテキストウィンドウを長くするだけでなく、以下のような要素を含む可能性があります。

- 文脈情報の階層化: 全体の概要、直近のやり取り、特定の重要情報などを区別して管理する。

- 動的な情報更新: 対話が進むにつれて、古い情報や重要度の低い情報を忘れ、新しい情報を取り込む仕組み。

- 外部知識との連携ルール: RAGなどで外部情報を参照する際の最適なタイミングや方法の定義。

- 複数のモデル/エージェント間での文脈共有: マルチエージェントシステムなどで、エージェント間で効率的に情報を共有するためのプロトコル。

[長期記憶 (外部DB/ベクトルストア)] ←→ [MCP (文脈管理エンジン)] ←→ [短期記憶 (LLMの内部状態/コンテキストウィンドウ)]

LLMがより人間らしい対話能力や、複雑なタスクを最後までやり遂げる能力を獲得するためには、この「文脈をいかにうまく扱うか」という問題、すなわちMCP的な概念の洗練が不可欠です。AGI(汎用人工知能)の実現に向けた重要なステップの一つとも言えるでしょう。