AIはエンタメだけじゃない!ビジネス現場への浸透

概要

生成AIというと、文章を書いたり、絵を描いたり、音楽を作ったりといったクリエイティブな側面や、ChatGPTのような対話型AIが注目されがちですが、今、その波は急速にビジネスの世界、特に企業の日常業務の効率化・自動化へと押し寄せています。これが**「エンタープライズAI」**と呼ばれる分野です。地味に聞こえるかもしれませんが、私たちの働き方を根本から変える可能性を秘めた、非常に重要なトレンドなのです。

ServiceNowってどんな会社?~ 企業の「縁の下の力持ち」 今回注目するServiceNowは、多くの大企業で使われているクラウドプラットフォームを提供している会社です。具体的には、IT部門のシステム運用管理(ITSM)、人事部門の従業員サポート、顧客サービス部門の問い合わせ管理、さらにはアプリケーション開発など、企業内の様々な部署のワークフロー(仕事の流れ)をデジタル化し、効率化するお手伝いをしています。いわば、企業の様々な業務をスムーズに進めるための「縁の下の力持ち」的な存在です。

AI機能「Now Assist」が業務をどう変える? ServiceNowは、自社のプラットフォーム全体に**「Now Assist」**という生成AI機能を組み込んでいます。これにより、これまで人間が時間と手間をかけて行っていた様々な業務が、AIのサポートによって劇的に効率化されようとしています。

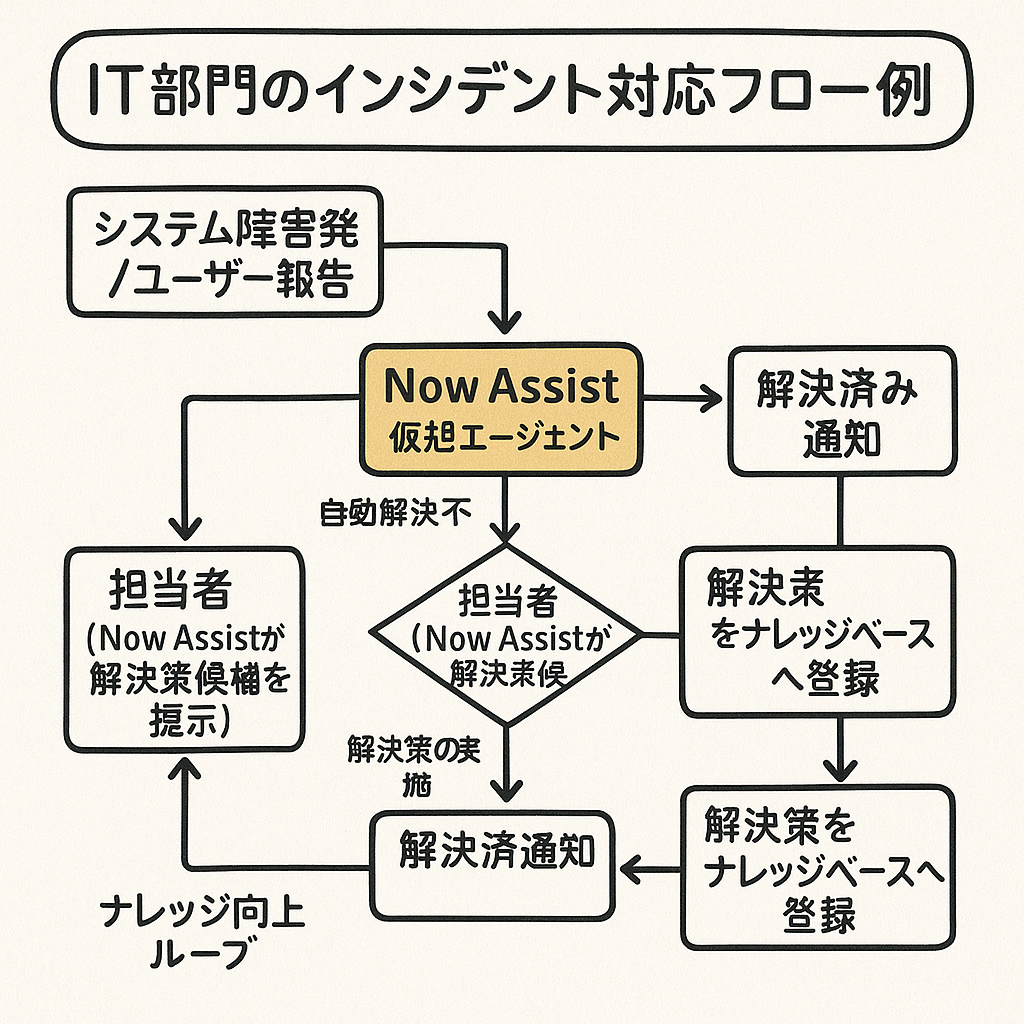

- IT部門での活用例:

- システム障害時の対応迅速化: 大量のログデータや過去の類似事例をAIが瞬時に分析し、障害の原因特定や解決策の提案を行います。担当者はAIの助けを借りて、より早く問題を解決できます。

- 問い合わせ対応の自動化: 社員からのITに関する問い合わせ(例:「パスワードをリセットしたい」「VPNに接続できない」)に対し、AI搭載の**仮想エージェント(チャットボット)**が24時間365日、自動で回答します。これにより、IT担当者はより複雑な問題に集中できます。

- コード生成支援: 簡単な社内ツールや自動化スクリプトの作成を、自然言語での指示に基づいてAIが支援します。

- 人事部門での活用例:

- 従業員からの問い合わせ対応: 休暇制度や福利厚生に関する質問などに、仮想エージェントが回答します。

- FAQや社内文書の自動作成・更新: 最新の社内規定に基づいて、よくある質問とその回答集(FAQ)などをAIが効率的に作成・管理します。

- 顧客サービス部門での活用例:

- 問い合わせ内容の自動要約: 顧客からの長い問い合わせメールやチャット履歴をAIが要約し、担当者が素早く状況を把握できるようにします。

- 返信メールの文案作成支援: 顧客への丁寧で適切な返信文案をAIが提案し、担当者の作業時間を短縮します。

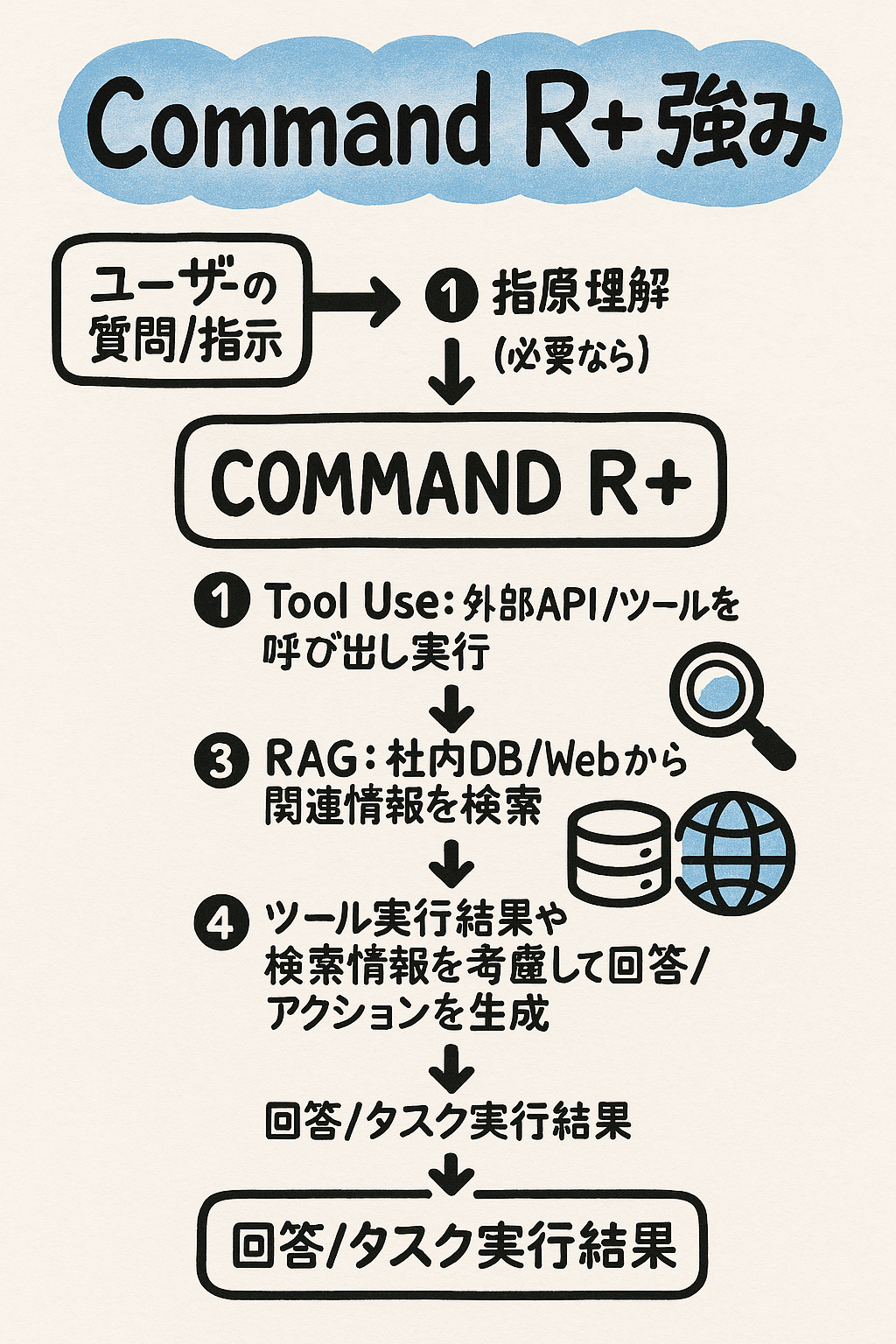

なぜ効果が出る?その仕組みは? Now Assistが効果を発揮する背景には、いくつかの技術的要素があります。

- RAG (Retrieval-Augmented Generation) の活用: 社内に蓄積された膨大なマニュアル、過去の事例、ナレッジベースといった「企業の知識」をAIが検索・参照して回答を生成するため、より正確で状況に合ったサポートが可能になります。

- プロセスマイニングとの連携: 企業の実際の業務プロセスデータを分析し、非効率な点やボトルネック(滞留箇所)を発見するプロセスマイニングという技術と連携。AIが改善策を提案し、自動化を促進します。

- プロセスマイニングとは?: システムのログデータを分析して、実際の業務がどのように行われているかを可視化・分析する技術。

- ローコード/ノーコード開発プラットフォーム: プログラミングの専門知識が少なくても、AIの支援を受けながら業務アプリケーションを開発できる環境を提供します。

図解的イメージ(IT部門のインシデント対応フロー例):

導入のメリットと乗り越えるべき課題 エンタープライズAI導入のメリットは、劇的な生産性向上、コスト削減、従業員満足度の向上などが期待される点です。これまで人間が忙殺されていた定型業務から解放され、より創造的で付加価値の高い仕事に集中できるようになります。 一方で、データプライバシーとセキュリティの確保(特に顧客情報や機密情報を扱う場合)、既存の社内システムとのスムーズな連携、AIを使いこなすための従業員のスキルアップや意識改革、そして導入コストに見合う効果(ROI)をどう測定し、証明するかといった課題も存在します。

今後の展望:AIによる「働き方改革」は加速する ServiceNowのようなプラットフォームは、今後さらに多くの業務プロセスへとAIの適用範囲を広げ、特定の業界(金融、医療、製造など)に特化したソリューションも強化していくと考えられます。また、テキストだけでなく、音声や画像も扱えるマルチモーダルAIの活用も進むでしょう。 来週(5月7日~9日)にはServiceNowの年次カンファレンス「Knowledge 2025」がラスベガスで開催される予定で、そこでの新たな発表にも注目が集まっています。

まとめ:AIと共に働く未来への準備 エンタープライズAIは、もはや未来の話ではなく、現実のビジネスを変革し始めています。ServiceNowの事例は、AIがいかに企業の「縁の下の力持ち」となり、私たちの働き方をより効率的で、より人間らしいものに変えていく可能性を示しています。企業も個人も、この変化にどう向き合い、AIをどう活用していくかを真剣に考える時期に来ていると言えるでしょう。