🤖 最新AIニュース総覧

2025年6月26日 – 信頼できるソースから収集した最新情報

スタンフォード大学の調査で、AIエージェントとの協働に対する労働者の意欲が高まっていることが判明。一方で、AIの普及による電力消費増加や環境問題への懸念も浮上。

Sakana AIが「教師モデル」を開発し、LLMの推論力を軽量化。生成AIノーコードツールの比較や、メタのAI開発における著作権問題も注目される。

日本政府とブルガリア政府がAI分野で協力強化。アンソロピックが都内にアジア初拠点を設立し、OpenAIが中国政府関与のAI開発に警告を発している。

豊和がAIを活用した工場自動化を推進し、搬送ロボット導入で売上8割増を見込む。IBMやメタがAIソフトウェア開発支援の新技術を発表。

情報幾何学の創始者である甘利俊一氏が、AI理論の基盤への貢献により第40回京都賞を受賞。授賞式は11月10日に開催予定。

2025年6月 – 日経新聞、Ledge.ai、AINOWから収集した主要トピック

AIによる雇用代替が加速し、特に女性やコールセンター業務への影響が顕著になっています。

画像診断、商談提案、教育など多岐にわたる分野で生成AIの実用化が進んでいます。

AI開発に必要なインフラ整備と技術革新が急速に進展しています。

AI技術の発展に伴い、透明性や安全性に関する議論が活発化しています。

企業におけるAI活用が本格化し、新たなビジネスモデルが生まれています。

2025年6月21日 – 日経新聞、Ledge.ai、AINOWから収集

Midjourneyの動画生成モデル「V1」公開、Perplexityの「Pages」発表など、生成AIの機能拡張と多様な分野での応用が進んでいます。

NVIDIAによるStable DiffusionのVRAM削減、Hugging Faceのパラメータ数フィルターなど、AIモデルの効率化と実用化に向けた取り組みが活発化しています。

OpenAIとMicrosoftの提携における独禁法問題、AIによる著作権侵害訴訟など、AIの社会実装に伴う倫理的・法的課題への対応が求められています。

NVIDIAのAIサーバー生産におけるヒト型ロボット導入検討、中国の侵襲型BCI臨床試験など、AIを支えるハードウェアやインフラの進化が続いています。

ハーバード大学によるAI訓練向け書籍データセット公開、noteのAI企業向け学習用コンテンツ提供など、AIの学習データに関する動きが活発です。

AmazonのAIによる従業員削減、NTTコミュニケーションズのAIエージェント提供など、様々な産業でのAI導入とビジネスモデル変革が進んでいます。

MetaのAI世界モデル「V-JEPA 2」、FutureHouseの化学推論特化AIモデル「ether0」など、基礎研究や新技術の開発も継続されています。

メタのOpenAI人材引き抜き、高卒就活におけるAI活用、AI議事録ツールなど、AI人材の確保と育成、教育現場でのAI活用が注目されています。

2025年6月20日 – 信頼できるソースから収集した最新のAI動向

ChatGPT、GPT-4o、画像生成AI、コード生成AIなど、生成AI技術の急速な進歩と多様な応用分野への展開

企業におけるAI導入が加速し、議事録作成、チャットボット、業務効率化など様々な分野で活用が進展

AI技術の発展に伴い、倫理的利用と安全性確保に関する議論が重要視され、各社が対策を強化

金融、教育、医療、エンターテイメントなど、あらゆる業界でAI技術の活用が広がり、社会全体に影響

2025年6月19日 – 日経新聞、Ledge.ai、AINOWから収集した最新情報

生成AIは企業活用、政府・教育機関の対応、アート・エンタメ・消費者領域での浸透が急速に進んでいます。半導体業界の活況と共に、AIの社会実装が加速しています。

NTTコムの400社へのAIエージェント提供、リコーのAI交渉支援、アフラックのAIコールセンター人員削減など、様々な業界でAIによる業務プロセスの自動化が進展しています。

MetaとOpenAIの人材獲得競争、慶應義塾大学のAIトラップを使った生成AI対策、米中AI特許競争など、AI技術の発展に伴う倫理的・社会的課題が浮き彫りになっています。

NVIDIAのTensorRTによるStable Diffusion 3.5 LargeのVRAM削減、MetaのV-JEPA 2による物理的整合性推論、リコーの複雑図表読み取り特化マルチモーダルLMMなど、技術革新が続いています。

無料AIイラスト作成ツールの比較、ディズニーとユニバーサルによるMidjourneyへの著作権侵害訴訟、おもちゃのマテルとOpenAIの提携など、クリエイティブ分野でのAI活用と課題が注目されています。

日経新聞、Ledge.ai、AINOWなどから収集した主要トピック

画像生成、創薬、コンテンツ作成、図表読み取りなど、多岐にわたる分野での生成AIの進展と実用化が進んでいます。

AIエージェントの責任、ディープフェイクの検出、AI社会の構築、コンテンツの無断学習、教育におけるAI対策、AIモデルの悪用など、AIが社会に与える影響とそれに対する議論が活発化しています。

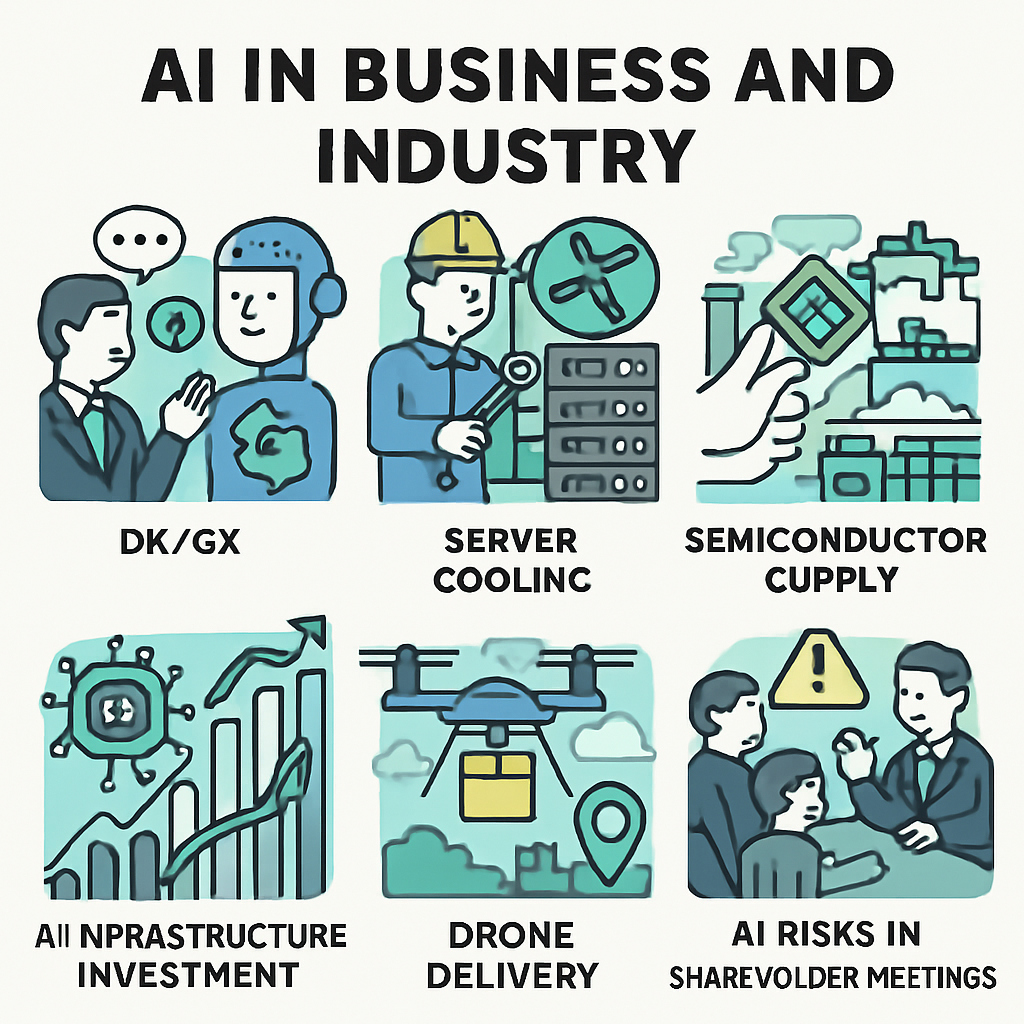

DX/GX、サーバー冷却、半導体供給、AIインフラへの投資、ドローン配送、株主総会でのAIリスクなど、ビジネスや産業分野でのAI導入と活用が加速しています。

Apple、NVIDIA、OpenAI、Amazon、サム・アルトマン、リコーなど、AI業界を牽引する主要企業や人物の動向と戦略に注目が集まっています。

Google DeepMind、AGI時代への備えを本格化──「リスクを無視して未来は築けない」

概要:

人工知能(AI)の研究を牽引するGoogle DeepMindが、汎用人工知能(AGI)時代の到来に向けた詳細な報告書を公開しました。全145ページにわたるこのレポートでは、AGIがもたらす恩恵だけでなく、社会・経済・倫理に関わるリスクについても率直に言及し、業界に大きなインパクトを与えています。

AGIとは、人間のように柔軟に考え、複数のタスクをこなせる高度なAIのこと。まだ完全には実現されていないものの、ChatGPTのような高性能な言語モデルが一般にも普及しつつある今、AGIはもはや遠い未来の話ではなくなっています。DeepMindはこの報告書の中で、「AGIの到来がいつであっても、今から備えることが重要」と強調します。

報告書は、リスクを4つのカテゴリーに分類しています。たとえば「AIの暴走リスク」「経済への過剰な影響」「社会構造の変化」「情報の偏りや操作」といったテーマがあり、それぞれに対する緩和策や、政策面での提案も丁寧にまとめられています。

注目すべきは、DeepMindが単なる企業努力にとどまらず、政府・研究機関・市民社会と連携する「共有の責任」としてこの問題に取り組もうとしている点です。これは、企業が技術革新の先陣を切る一方で、その影響を社会全体とともに考え、設計していこうという姿勢の現れです。

私たちの生活や働き方、価値観にまで影響を及ぼす可能性のあるAGI。SFの話として片づけるには、もう遅すぎるかもしれません。今こそ、開発だけでなく“設計された未来”を議論することが求められています。

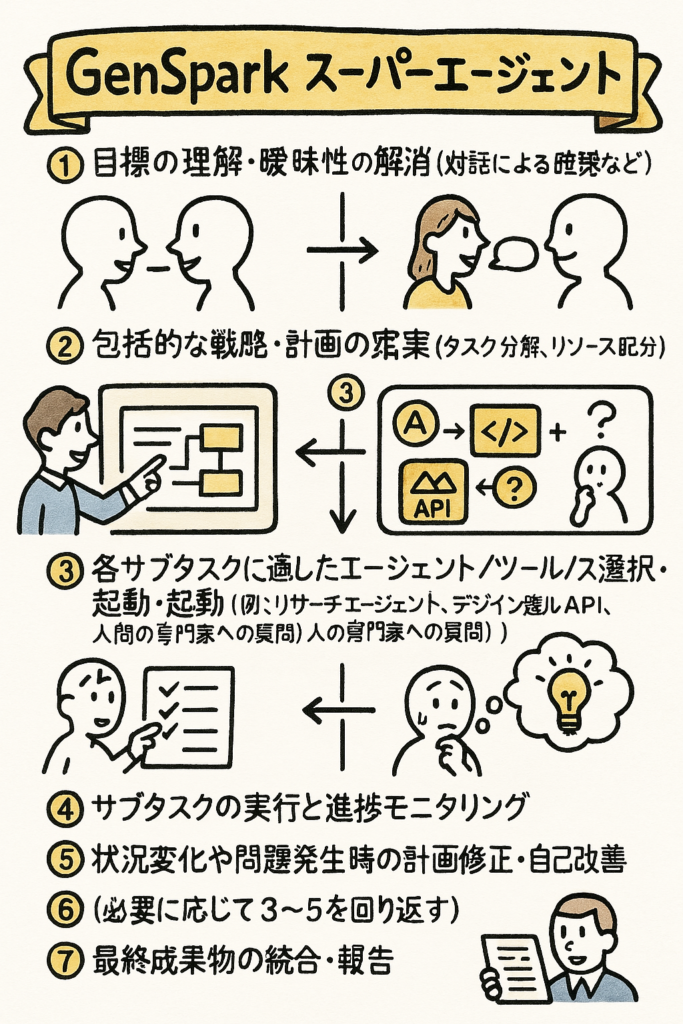

次世代のAIアシスタント?「GenSpark スーパーエージェント」が目指すものとは

先週、AI界隈で大きな注目を集めたキーワードの一つが「GenSpark スーパーエージェント」です。まだ公式な発表や詳細な技術文書は限られているようですが、噂や一部の情報によると、これは単一のタスクだけでなく、複数の複雑な目標を理解し、自律的に計画を分解・実行し、必要に応じて自己修正しながら長期的なプロジェクトを遂行できる高度なAIエージェントを指す概念、あるいは開発中のプロジェクト名ではないかと見られています。

従来のAIエージェントとの違い(推測を含む):

図解的イメージ(スーパーエージェントの概念):

[ユーザーの抽象的な目標/長期プロジェクト] ↓ 【GenSpark スーパーエージェント】 ① 目標の理解・曖昧性の解消(対話による確認など) ② 包括的な戦略・計画の立案(タスク分解、リソース配分) ③ 各サブタスクに適したエージェント/ツール/スキルの選択・起動 (例: リサーチエージェント、コーディングエージェント、デザインツールAPI、人間の専門家への質問) ④ サブタスクの実行と進捗モニタリング ⑤ 状況変化や問題発生時の計画修正・自己改善 ⑥(必要に応じて③~⑤を繰り返す) ⑦ 最終成果物の統合・報告 ↑ [継続的な学習ループ]

現状と今後: 「GenSpark」が特定の製品名なのか、あるいは次世代AIエージェントのコンセプトを示す一般的な用語なのか、現時点ではまだ情報が錯綜しています。しかし、このような高度な自律性と汎用性を持つ「スーパーエージェント」の実現に向けた研究開発が加速していることは間違いありません。これが実現すれば、科学研究、ビジネス、クリエイティブ作業など、様々な分野で人間の能力を拡張する強力なパートナーとなる可能性があります。今後の正式な発表や技術詳細に注目が集まります。ントは、AIの能力を飛躍的に高める可能性を秘めた、非常に注目すべき技術分野です。

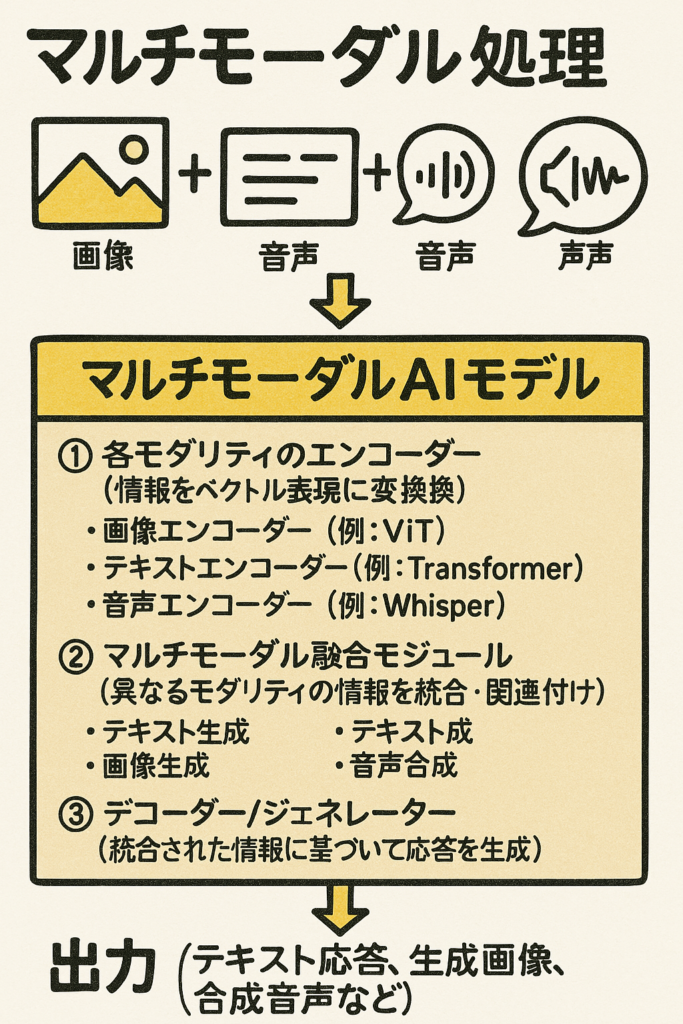

見て、聞いて、話せるAIへ!マルチモーダルAIが実現する次世代インターフェース

AIがテキストだけでなく、画像、音声、動画といった複数の情報形式(モダリティ)を統合的に理解し、生成する「マルチモーダルAI」の進化が止まりません。先週も、いくつかの興味深い研究発表や技術デモンストレーションがありました。

注目すべき進展:

技術的背景: これらの進展の背景には、大規模言語モデル(LLM)と、画像認識や音声認識などの他のAI技術を効果的に統合するアーキテクチャの研究があります。例えば、「Vision Transformer (ViT)」のような画像認識モデルと言語モデルを接続したり、異なるモダリティの情報を共通の表現空間(埋め込み空間)で扱ったりする技術が用いられています。

図解的イメージ(マルチモーダル処理):

[入力] (画像データ + テキスト指示 + 音声) ↓ 【マルチモーダルAIモデル】 ① 各モダリティのエンコーダー (情報をベクトル表現に変換) – 画像エンコーダー (例: ViT) – テキストエンコーダー (例: Transformer) – 音声エンコーダー (例: Whisper) ② マルチモーダル融合モジュール (異なるモダリティの情報を統合・関連付け) ③ デコーダー/ジェネレーター (統合された情報に基づいて応答を生成) – テキスト生成 – 画像生成 – 音声合成 ↓ [出力] (テキスト応答、生成画像、合成音声など)

今後の展望: マルチモーダルAIは、より直感的で豊かな人間とAIのインタラクションを実現する鍵となります。スマートグラスのようなウェアラブルデバイスとの連携や、教育、医療、エンターテイメントなど、様々な分野への応用が期待されます。とによる制御の難しさ、予期せぬ行動のリスク、コスト(多くのAPIコールや計算資源を消費する可能性)などが課題として挙げられます。しかし、AIエージェントは、AIの能力を飛躍的に高める可能性を秘めた、非常に注目すべき技術分野です。