巨大化だけじゃないAIの進化

概要

ChatGPTの登場以降、大規模言語モデル(LLM)はそのパラメータ数を増やし、性能を高める方向で、いわば「巨大化」の競争が続いてきました。しかし、その一方で、より小さく、より効率的に動作するAIモデルへの需要も高まっています。なぜなら、巨大なモデルは高性能ですが、動かすためには強力なサーバーと大量の電力が必要で、コストもかかり、応答に時間がかかることもあるからです。

そんな中、先週Microsoftが発表した**「Phi-3」ファミリーは、「小さいけれど、驚くほど賢い」をコンセプトにした小型言語モデル(SLM: Small Language Model)として大きな注目を集めました。これは、AIがクラウド上だけでなく、私たちのスマートフォンやパソコン、さらにはもっと小さなIoTデバイスの上で直接動く「オンデバイスAI」**時代の到来を予感させる重要な一歩と言えるでしょう。

Phi-3ファミリーとは?~ 小さくてもパワフル! 今回発表されたのは、Phi-3ファミリーの中でも最も小さい**「Phi-3-mini」です。今後、より大きな「Phi-3-small」と「Phi-3-medium」**もリリース予定とされています。

- Phi-3-miniの特徴:

- サイズ: 38億(3.8B)パラメータと、GPT-3.5(1750億パラメータと言われる)などと比べると非常に小さい。

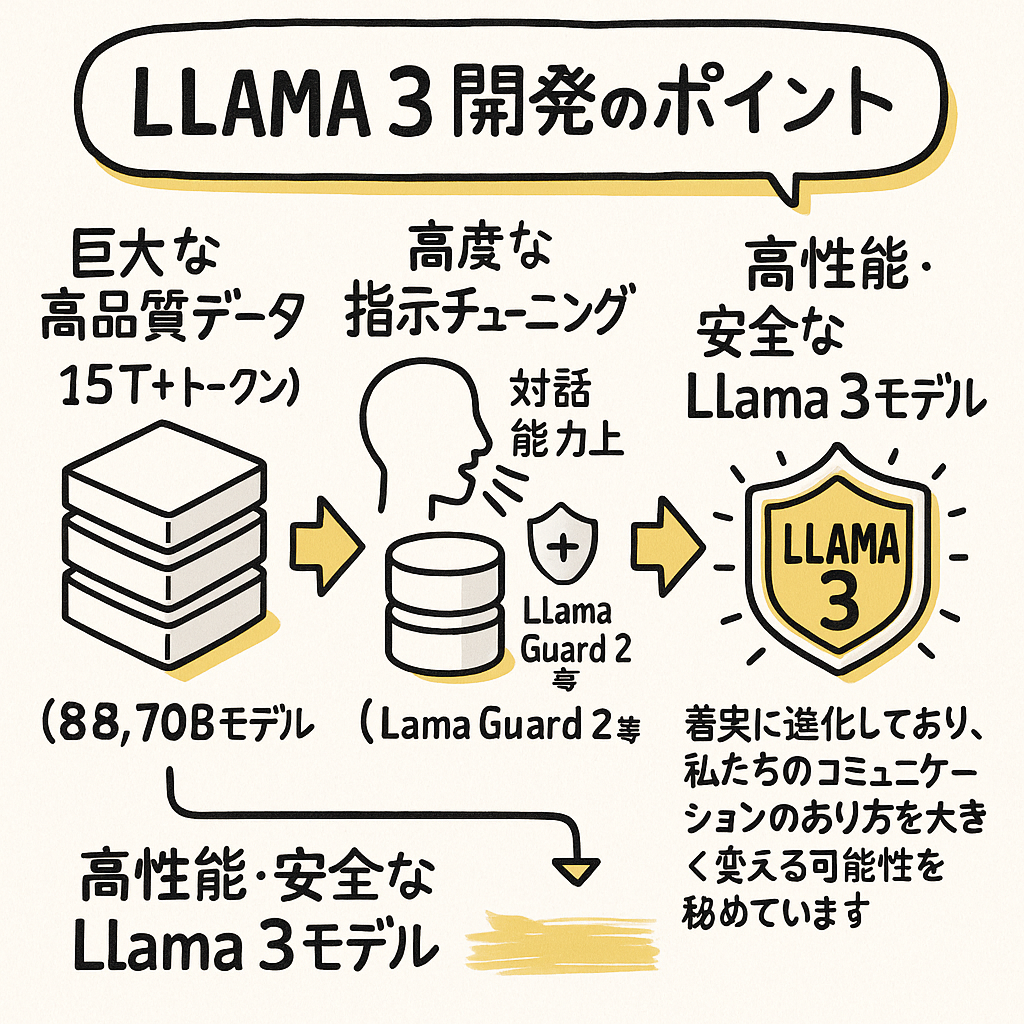

- 高性能: Microsoftによると、このサイズにもかかわらず、一般的な言語理解、数学、コーディングなどのベンチマークテストにおいて、2倍以上のパラメータ数を持つ他のモデル(例: MetaのLlama 3 8B Instructの一部タスクやMistral 7Bなど)と同等か、それ以上の性能を示したと報告されています。

- コンテキスト長: 最大12万8000トークン(128K)のコンテキスト長をサポートするバージョンもあり、長い文章や会話の文脈を理解する能力も比較的高いです。

- コンテキスト長とは?: モデルが一度に処理できる情報の量(単語や文字のかたまりの数)。これが長いほど、より多くの文脈を理解できます。

- 利用しやすさ: モデルサイズが小さいため、スマートフォンやノートPCなど、インターネット接続がないオフライン環境でも動作させることが可能です。

なぜこんなに高性能?秘密は「学習データの質」 Phi-3が小さいながらも高い性能を発揮できる秘密は、その学習方法にあります。Microsoftは、単にインターネット上の膨大なテキストデータを集めるのではなく、教科書やウェブデータから**「質」を重視して厳選・フィルタリングしたデータセット**(論文では”heavily filtered web data and synthetic data”と表現)で学習させました。量より質を追求することで、より効率的に知識や推論能力を獲得できたと考えられます。これは、以前のバージョンであるPhi-1やPhi-2から続く開発思想です。

どんなことに使えるの?広がる応用シーン Phi-3のような高性能な小型モデルは、様々な応用が期待されます。

- スマートフォンアプリ: オフラインでの文章要約、翻訳、チャットボット機能などをアプリに直接組み込めます。ユーザーのデータが外部サーバーに送られないため、プライバシー保護の観点からも有利です。

- IoTデバイス: スマートスピーカーや家電製品が、より賢く、ユーザーの指示を自然に理解できるようになるかもしれません。

- エッジコンピューティング: 工場のセンサーデータ分析や、自動運転車の状況判断など、リアルタイム性が求められ、クラウドとの通信が難しい場面での活用。

- 教育ツール: インターネット環境がない場所でも利用できる学習支援ツール。

- 開発支援: ローカル環境で動作するコーディングアシスタント。

LLMのポジショニング:

コード スニペット

graph TD

A[大規模LLM (GPT-4, Claude 3 Opusなど)] -- クラウド上で動作 --> B(メリット: 非常に高い性能、広範な知識<br>デメリット: 高コスト、応答遅延の可能性、要ネット接続);

C[小型LLM (Phi-3-miniなど)] -- デバイス上で動作可能 --> D(メリット: 低コスト、高速応答、オフライン可、プライバシー向上<br>デメリット: 知識量や複雑なタスクへの対応力は限定的);

subgraph 特徴

direction LR

X(コスト/リソース);

Y(性能/知識量);

Z(応答速度/オフライン);

end

A -- 高 --> X;

A -- 高 --> Y;

A -- 低 --> Z;

C -- 低 --> X;

C -- 中〜高 (サイズ比) --> Y;

C -- 高 --> Z;

(上記はMermaid記法のテキスト表現です。モデルの特性を対比的に示しています)

メリットとデメリット Phi-3の最大のメリットは、低コスト、高速な応答、オフラインでの利用可能性、そしてプライバシーの向上です。一方で、その小さなサイズゆえに、最新の出来事に関する知識が少なかったり、非常に複雑でニュアンスに富んだ長文の生成や推論は、やはり最先端の大規模モデルには及ばない可能性があります。まさに「適材適所」で使い分けることが重要になります。

今後の展望とAIの未来 Phi-3ファミリーの登場は、AIが特別なサーバーの中だけでなく、私たちの手元にあるデバイスの中で、より身近な存在になる未来を示唆しています。今後、smallやmediumといったモデルが登場することで、性能と効率のバランスが取れた選択肢がさらに増えるでしょう。Appleなどもデバイス上AIに注力していると噂されており、この「小型・高効率AI」の流れは今後ますます加速していくと考えられます。

まとめ MicrosoftのPhi-3は、LLM開発における新たな方向性を示す重要な一歩です。「大きいことは良いことだ」という流れに一石を投じ、AIをより多くの場所で、より手軽に、より安全に利用できる可能性を広げました。この技術が私たちの生活や仕事をどのように変えていくのか、今後の展開から目が離せませんね。